14 апреля 2026

Вы тратите бюджет на то, что Google уже не учитывает: реальные факторы ранжирования в 2026 году

377

За последние годы поисковая выдача стала менее предсказуемой: ИИ-обзоры, апдейты алгоритмов и конкуренция влияют на то, как именно происходит ранжирование сайтов в Google. Часть подходов, которые раньше считались базовыми, теперь работают нестабильно или дают эффект только в ограниченных сценариях. Фиксированного перечня факторов ранжирования нет — одни и те же приемы могут давать разный результат даже внутри одной ниши. Алгоритмы используют сотни сигналов, но их влияние не закреплено и меняется вместе с выдачей.

Рассказываем, какие SEO-факторы ранжирования действительно имеют значение сейчас, а какие стоит воспринимать осторожно, если цель — выйти в топ Google.

- Как работает ранжирование Google в 2026 году

- Факторы, связанные с контентом

- Ссылочные факторы

- Технические факторы и пользовательский опыт

- Поведенческие факторы

- Топ-5 фактов о ранжировании Google

- Коротко: на что делать ставку в SEO в 2026 году

Как работает ранжирование Google в 2026 году

Google описывает процесс довольно открыто. В основе лежит система сигналов, которая постоянно оценивает три вещи: что именно ищет пользователь, подходит ли страница под этот запрос, и можно ли ей доверять.

Вес каждого сигнала меняется. Один и тот же фактор может быть решающим для одного запроса и почти бесполезным для другого. Например, для новостей важна свежесть, для справочных тем она практически не учитывается.

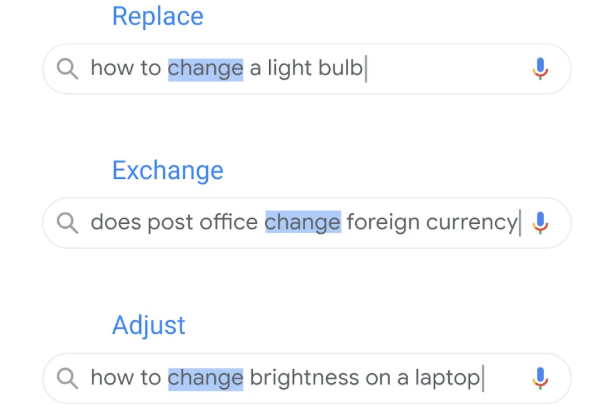

Первый шаг — интент. Google пытается понять задачу и решить проблему пользователя. Запросы «купить айфон» и «лучший айфон 2026» внешне похожи, но выдача будет разной: в первом случае Google покажет магазины, во втором — обзоры и сравнения. Отсюда частая ошибка, которую упускают из виду: страница с идеальной оптимизацией не ранжируется, потому что попала не в тот тип выдачи. Мартовское обновление 2026 года только усилило акцент на точном совпадении с интентом.

Второй — сам контент. Google оценивает не только наличие ключевых слов, но и общую полезность страницы, например, есть ли структура, списки, таблицы, изображения. Система проверяет, отвечает ли страница на запрос так, как от нее ожидают. Страница должна выглядеть как логичный ответ на вопрос читателя, поэтому полотно текста, напичканное ключами, не вписывается в эту логику.

Третий слой — поведенческие сигналы. Google официально не называет их прямыми факторами, но это скорее юридическая формулировка. На практике данные о поведении пользователей используются напрямую. Утечка API Google в 2024 году подтвердила существование системы NavBoost, которая анализирует клики по результатам поиска за последние 13 месяцев.

Что именно смотрит Google:

- CTR — как часто кликают по вашему сниппету. По данным First Page Sage на 2026 год, первая позиция в органике забирает в среднем 26,4% кликов, вторая — 12,1%, третья — 6,7%. При появлении ИИ-обзоров CTR первой позиции может падать еще сильнее.

- Dwell time — время, которое посетитель проводит на странице перед возвратом в поиск. Длительность пребывания пользователя на сайте считается сильным сигналом удовлетворенности. Если человек задержался надолго — хорошо. Если быстро вернулся в выдачу — поисковик может опустить страницу.

- Pogo-sticking — возврат в поиск сразу после клика. Самый явный негативный сигнал, ведь это значит, страница не дала того, что обещал сниппет.

Google смотрит на агрегированные данные и тренды. Один резкий всплеск накрутки ничего не даст, а вот устойчивые паттерны поведения влияют на позиции.

Отдельно нужно сказать про индексацию. Ранжирование — это финальный этап, до него страница должна пройти через сканирование и попасть в индекс. По правилам Google сканирование не гарантирует индексацию, а индексация — не гарантирует ранжирование. Если система решила, что страница не нужна, она не получит показов, сколько бы вы ее ни оптимизировали.

В 2026 году страница должна пройти длинный путь.

- Попасть в индекс.

- Пройти отбор по интенту.

- Предоставить релевантный ответ.

- Обойти конкурентов по качеству и поведенческим сигналам.

И только после этого она начинает бороться за позиции. Поэтому универсальных SEO факторов ранжирования нет, ведь без учета интента и контекста выдачи они не работают.

Факторы, связанные с контентом

В документации Google сказано, что страница «должна быть полезной, заслуживать доверия и делаться для людей». Рассказываем, как это работает.

Что Google проверяет в контенте. Первый и главный вопрос — закрывает ли страница запрос. Человек ищет «как выбрать прокси», значит, ему нужен разбор с критериями, сравнениями, нюансами. Поэтому общий текст, в который просто добавили ключевики, его не заинтересует. Февральское обновление 2026 года подтверждает, что поверхностные статьи теряют позиции, а качественные, хорошо структурированные — выигрывают.

Отсюда и вытекает важность глубины. В топе редко держатся страницы, которые раскрывают тему без особой пользы. Обычно там материалы, где захвачены смежные вопросы: протоколы, скорость, обзор, подборка или сравнение нескольких вариантов, стоимость. Мартовское обновление 2026 года усилило акцент на сравнительной ценности: чем выше релевантность и полезность, тем стабильнее позиции.

Структура и оформление. Понятная структура — это то, что удерживает посетителя. Логические блоки, списки, таблицы, внятные заголовки — все, что помогает быстро найти нужное. Теперь поисковик строже оценивает и структуру ресурса, и пригодность материала для цитирования. Людям все сложнее читать простыни текста, и Google это хорошо понимает.

В ряде ниш таблицы или сравнения заметно повышают удержание, поскольку с ними человек быстрее принимает решение. Ранжирование в Google теперь строится вокруг сравнительной ценности, то есть алгоритм оценивает, насколько ваш ответ полезнее, чем у конкурентов. Поэтому структура, помогающая сравнивать, выигрывает.

Изображения, видео, схемы работают по той же логике. В 2026 году видеоконтент перестал быть просто дополнением. Поисковые системы научились смотреть и слушать видео так же, как раньше читали текст. Видео превратилось в один из базовых сигналов ранжирования, потому что оно доказывает экспертность и опыт гораздо убедительнее текста.

Метатеги. Прежде чем пользователь попадет на сайт, он видит в поиске title, description и URL. От того, как они выглядят, зависит кликнут по странице или пройдут мимо. Даже хорошие позиции не гарантируют трафик, если сниппет не цепляет.

- Title. Он должен отражать суть страницы, соответствовать запросу и давать понять, что именно получит человек. В конкурентных нишах формулировка заголовка часто решает, перейдут на сайт или нет.

- Description. Google не учитывает описание при ранжировании, но оно влияет на кликабельность: если description попадает в ожидания пользователя, CTR растет. При этом поисковик не всегда берет то описание, которое задано в коде.

- URL. Короткие и понятные адреса выглядят надежнее длинных. Особенно это заметно в коммерческих темах, где пользователи обращают внимание на адресную строку.

Почему Google переписывает сниппеты. Google формирует сниппеты динамически. Система может менять и заголовок, и описание по трем причинам:

- заголовок не соответствует запросу;

- на странице есть более релевантный фрагмент текста;

- система считает, что можно лучше ответить на потребность пользователя.

Факторы выдачи напрямую влияют на то, получит ли страница трафик при уже занятых позициях.

E-E-A-T. Это модель, через которую поисковик объясняет алгоритмам, где полезный контент, а где нет.

- Experience. В 2026 году одного пересказа чужого мнения мало. Сайты, которые полагаются на AI-контент без контроля человека, после мартовского обновления потеряли от 60 до 80% трафика. Google понижает страницы, где умело пересказывают общеизвестные факты, но нет глубины и практики.

- Expertise. Мартовское обновление добавило проверку происхождения автора. Теперь Google сверяет биографии с LinkedIn и другими профилями. Система проверяет, совпадают ли заявленные навыки с реальным опытом. Сайты с контентом без подтвержденной экспертизы теряют позиции.

- Authoritativeness. Это собирательный сигнал: как часто на вас ссылаются, цитируют, возвращаются. Бренды, которых упоминают как источники в AI-обзорах, получают на 35% больше органических кликов, чем те, кого игнорируют.

- Trustworthiness. Если сайт не вызывает доверия, то опыт и экспертиза уже не важны. Надежность складывается из простых вещей: понятные контакты, ясная информация о компании, защищенное соединение, честные условия.

Сайты с высоким E-E-A-T стабильнее держатся в топе и реже проседают при обновлениях.

Ссылочные факторы

Google все еще воспринимает наличие ссылок на сайт как сигнал доверия. Но теперь оценивает их контекст: откуда ссылка, насколько тема близка, как она вписана в текст, выглядит ли естественно. На сайте компании сказано, что неестественные ссылки из схем обмена, покупных размещений или автоматически сгенерированные приносят больше вреда, чем пользы. Алгоритмы давно перешли от анализа отдельных ссылок к выявлению общих неестественных паттернов в профиле сайта.

Google также научился различать качественные и спамные сигналы, поэтому некачественные ссылки теперь могут вредить. При этом одно сильное упоминание с релевантного, авторитетного ресурса в 2026 году перевешивает десятки случайных ссылок с непрофильных площадок.

Технические факторы и пользовательский опыт

Google учитывает технические сигналы, в документации они называются дополнительными факторами ранжирования. Их влияние обычно слабее, чем у контента или ссылок.

Как скорость и стабильность страницы влияют на позиции. Вот три метрики Core Web Vitals, которые показывают, насколько страница удобна для реального человека:

- LCP (Largest Contentful Paint) — насколько быстро загружается главный контент (текст, картинка, видео). Норма — до 2,5 секунд.

- INP (Interaction To Next Paint) — как быстро страница реагирует на клики и касания. Норма — до 200 миллисекунд.

- CLS (Cumulative Layout Shift) — стабильны ли визуальные элементы при загрузке. Норма — до 0,1.

Сами по себе эти метрики редко двигают сайт в топ, они работают скорее как ограничение. Если с Core Web Vitals все плохо, страница начинает проигрывать конкурентам. Если ваш сайт грузится быстрее и не глючит, он получит преимущество.

Исследования это подтверждают. Сайты, которые не укладываются в нормативы Core Web Vitals, в среднем теряют около 3,7% поисковой видимости по сравнению с теми, у кого с этим порядок. Более того, 53% посетителей уходят, если страница на телефоне грузится дольше 3 секунд.

Мобильная адаптация. Google давно оценивает мобильную версию сайта, но это не значит, что адаптив сам по себе продвигает сайт. Скорее это базовое требование системы. Если мобильная версия неудобная, сайт будет хуже проходить отбор на уровне пользовательского опыта. В случае же, когда адаптивного варианта нет вообще, Google может не показывать сайт в выдаче на мобильных устройствах.

Что важно сделать для мобильной адаптации:

- оптимизировать верстку под узкие экраны — текст, изображения и блоки должны масштабироваться без искажений;

- сделать кнопки крупными, чтобы пользователям было удобно нажимать на них без промахов;

- использовать вертикальную ориентацию, поскольку горизонтальный скроллинг на мобильных устройствах недопустим;

- упростить код, убрать тяжелые скрипты, сжать изображения, использовать адаптивные форматы, чтобы страница быстро грузилась даже через мобильный интернет.

Технические проблемы почти всегда бьют по поведению пользователей. Медленная загрузка, некорректная верстка, неудобный интерфейс — все это напрямую влияет на то, что человек делает:

- закрывает страницу сразу;

- возвращается обратно в выдачу;

- не доходит до целевого действия.

Например, два лендинга с одинаковым контентом могут ранжироваться по-разному только из-за того, где быстрее грузится первый экран и понятнее оффер. Формально проблема техническая, но эффект проявляется через поведение пользователей.

Поведенческие факторы

Со временем система может пересмотреть релевантность страницы. Поисковик постоянно отслеживает, как пользователи ведут себя после перехода, использует эти данные как обучающую выборку и на основе этого корректирует свою оценку. ПФ делятся на два вида, разберем каждый из них.

Внешние ПФ, до перехода пользователя на сайт:

- CTR сниппета — как часто пользователи выбирают ваш ответ в выдаче;

- возврат в поиск — возвращается ли он к выдаче и выбирает ли другой результат.

Внутренние ПФ, поведение пользователя на самом сайте:

- время на странице — сколько человек провел на сайте до возврата в поиск;

- глубина просмотра — сколько страниц пользователь открыл за одну сессию;

- целевые действия — клики по кнопкам, заполнение форм, переходы по ссылкам;

- повторные визиты — если человек вернулся на сайт через какое-то время, поисковик получает сигнал, что ресурс полезен.

В отдельной статье про поведенческие факторы и их накрутку мы разбирали этот механизм подробнее, включая влияние накрутки и реальные ограничения.

Топ-5 фактов о ранжировании Google

В SEO до сих пор много установок, которые либо устарели, либо работают не так, как кажется. Разберем пять фактов, которые помогут не тратить время на то, что уже не работает.

Факт 1. Google не считает количество слов и не использует это как фактор ранжирования.

Представитель компании Джон Мюллер не раз это подтверждал: «Количество слов на странице не является ни качественным, ни ранжирующим фактором».

Длинные тексты действительно чаще оказываются в топе — потому что они лучше раскрывают тему. Поэтому делайте так, чтобы страница закрывала запрос. Если можно ответить коротко и понятно, нет смысла искусственно наращивать объем.

Факт 2. Google не использует плотность ключевых слов как фактор ранжирования. Алгоритмы давно работают на уровне смысла и контекста.

Исследование 2026 года на основе 1536 поисковых запросов не обнаружило устойчивой корреляции между плотностью ключевых слов и позициями в топе. Средняя плотность ключа в топ-10 результатов составила 0,04% — ключ почти не встречается, то есть корреляции с ранжированием нет.

Сейчас от этого подхода остался только вред в виде переспама.

Факт 3. Возраст домена напрямую не влияет на ранжирование.

Мюллер ни один раз подтверждал, что возраст домена не играет роли при ранжировании сайтов.

Старые домены часто успевают накопить ссылки, контент и доверие аудитории. На позиции влияет то, что с ним делали все это время.

Факт 4. Микроразметка не помогает ранжироваться лучше. Она нужна для расширенных сниппетов (рейтинг, цена, отзывы) и улучшает внешний вид в выдаче, но не позиции.

Джон Мюллер подтвердил: «Структурированные данные не заставят ваш сайт ранжироваться лучше».

Сниппет повышает кликабельность, а это косвенно может влиять на трафик.

Факт 5. Google не учитывает meta description при ранжировании с 2009 года.

В 2009 году было объявлено: «Даже если мы иногда используем метатег description для сниппетов, мы все равно не используем его в ранжировании».

Коротко: на что делать ставку в SEO в 2026 году

В топе Google остаются страницы, которые лучше других решают задачу пользователя. На что вам стоит обратить внимание:

- Интент. Страница должна отвечать именно на тот вопрос, который задал человек. Если не попали, все остальное бесполезно.

- Ссылки. Одна ссылка с тематического сайта может дать больше, чем десятки бессмысленных размещений. Google оценивает профиль в целом: релевантность доноров, естественность роста, разнообразие источников.

- Технические факторы. Медленная загрузка, отсутствие мобильной версии, некорректная верстка — все это бьет по поведению пользователей, а оно уже влияет на позиции.

- Сниппет. Заголовок и описание решают, кликнут по странице или нет. Иногда достаточно переписать title, чтобы трафик вырос без правок на самом сайте.

- Обновления. В некоторых темах контент со временем становится неактуальным, так как конкуренты выпустили более свежую и точную информацию. Поэтому не забывайте обновлять материалы на сайте.

Если подытожить, для ранжирования Гуглом страница должна попадать в интент, выглядеть надежно и быть удобной для пользователя.

Вам была полезна эта статья?

2

0

Похожие статьи