12 мая 2023

Нейросеть Stable Diffusion: что умеет, как установить и пользоваться бесплатно

13145

Нейросети для генерации изображений доступны не только онлайн. При наличии персонального компьютера и капельки усилий можно развернуть у себя нейросеть Stable Diffusion — и использовать ее совершенно бесплатно без всяких ограничений. Пошаговая инструкция — уже в нашей статье.

Топ-55 нейросетей для интернет-предпринимателей, маркетологов, фрилансеров, копирайтеров, SMM и SEO-специалистов — в нашей бесплатной подборке в Telegram.

Содержание:

- Что такое нейросеть Stable Diffusion

- На что способна нейросеть

- Системные требования и установка

- Учимся писать запрос

- Что получилось

Что такое нейросеть Stable Diffusion

Stable Diffusion — это нейросеть с открытым исходным кодом от компании Stability AI, которая генерирует изображения по текстовому запросу, может дорисовывать элементы и редактировать исходники, а также добавлять новые стили изображениям без цензуры.

ИИ использует диффузионные вероятностные модели, позволяющие поэтапно менять изображение, и только после нескольких повторов выдавать готовый результат. Такие модели уже используются в трехмерной графике и синтезе речи.

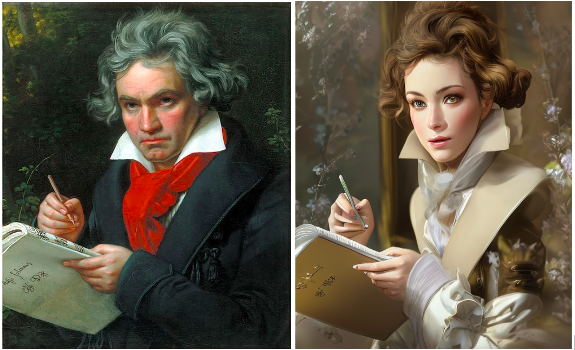

Пример использования:

Самое интересное, что благодаря доступности исходного кода нейросеть можно использовать практически в любых приложениях, работающих с изображениями, чем уже успели воспользоваться программа по 3D визуализации Blender и веб-редактор Canva.

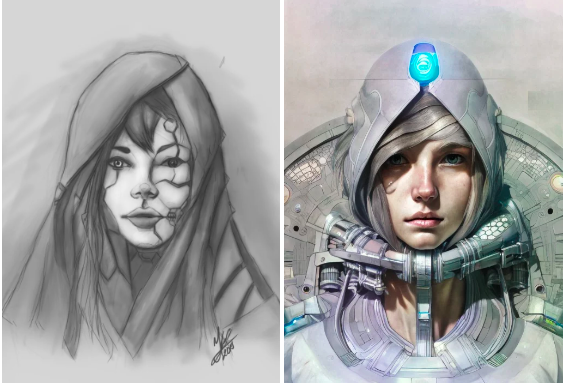

Пример работы Stable Diffusion — от эскиза художника до конечного варианта:

Работа Stable Diffusion с эскизом

На что способна нейросеть

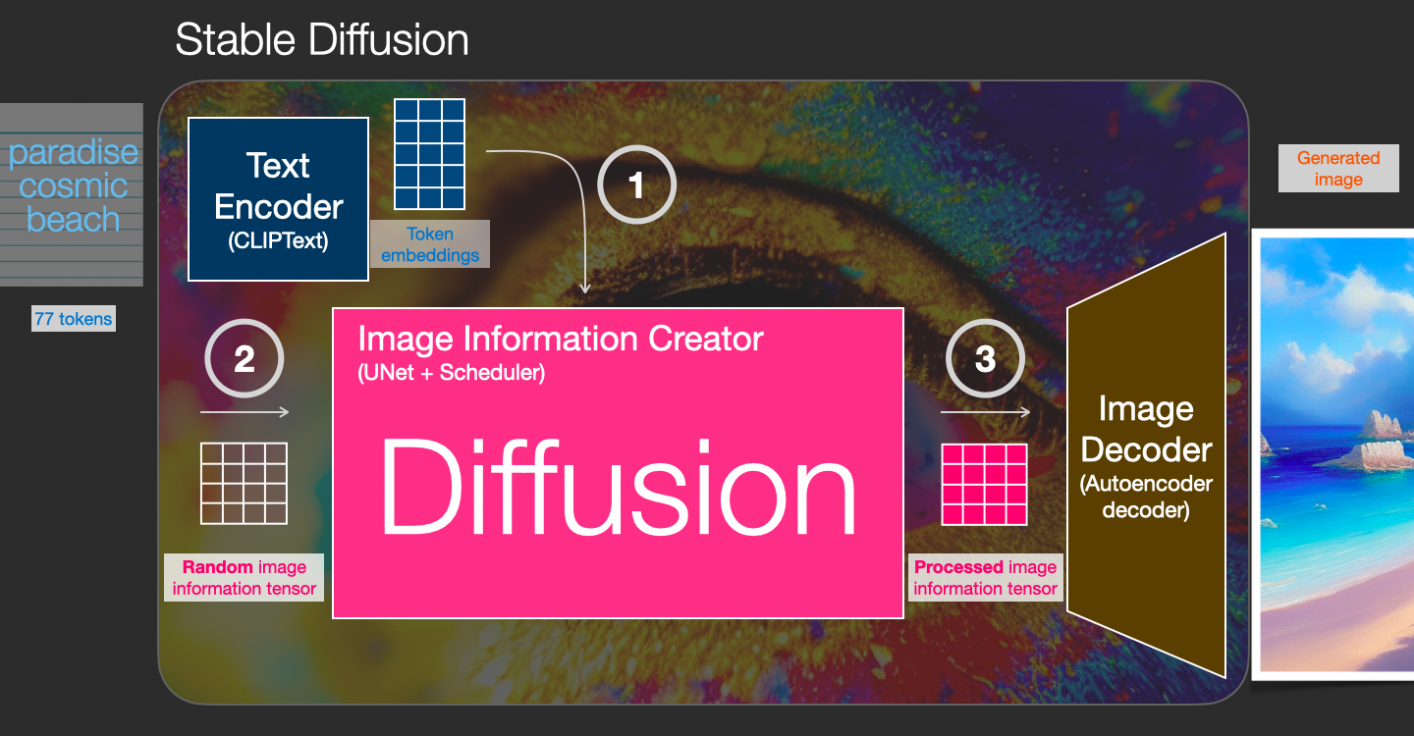

Чтобы понять, на что способна нейросеть, нужно знать, как она устроена.

Stable Diffusion состоит из:

- Кодировщика текста, который получает на входе текстовый запрос, и переводит его в набор чисел.

- Генератора изображений и алгоритма планирования, которые создают информацию об изображении.

- Декодера, создающего рисунок.

Устройство нейросети Stable Diffusion (авторство jalammar.github.io)

Благодаря такой модели работы нейросеть способна:

1. Генерировать фотореалистичные изображения по текстовому описанию (также доступны стили аниме, пейзажи, фэнтези и различные художественные стили):

Рекламные фото еды (автор: Neural.Academy)

2. Убирать ненужные объекты с фотографий:

Фото stable-diffusion-art.com

3. Создавать анимированные GIF.

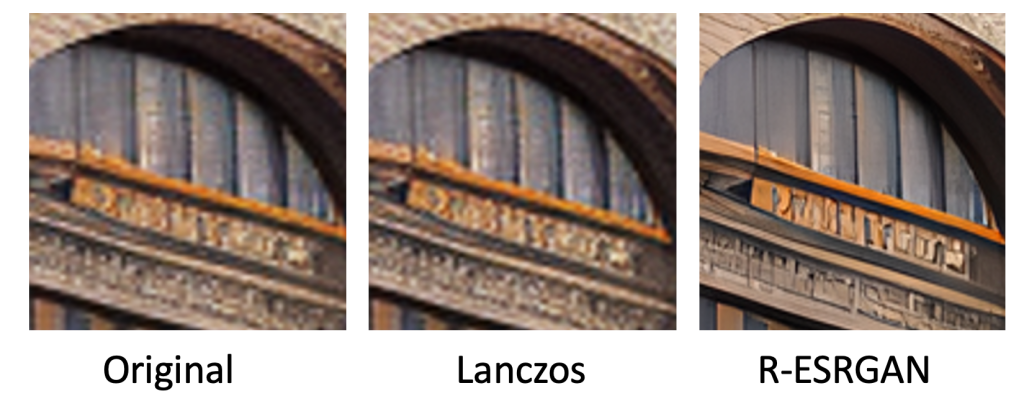

4. Улучшать детализацию изображения:

Фото stable-diffusion-art.com

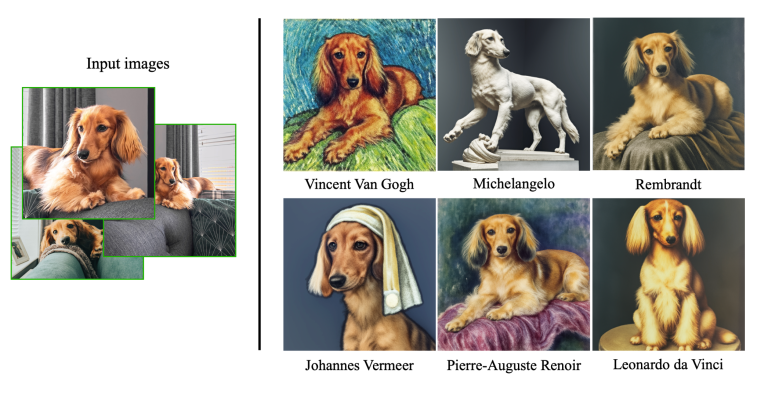

5. Добавлять изображения в нейросеть и менять их стилистику:

Фото stable-diffusion-art.com

6. Расширять фон изображений:

Фото stable-diffusion-art.com

7. Копировать позы по референсу:

Фото stable-diffusion-art.com

8. Добавлять обрезанные части тела на фото:

Фото stable-diffusion-art.com

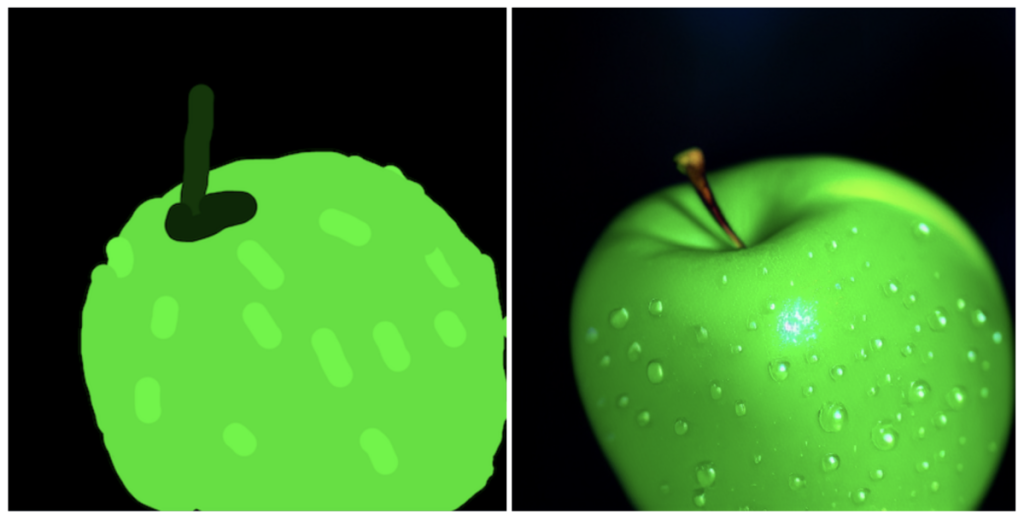

9. Превращать любительский рисунок в профессиональный:

Фото stable-diffusion-art.com

10. Трансформировать фото в стиле мультфильмов:

Фото stable-diffusion-art.com

Сложно перечислить все доступные инструменты для работы с изображениями от Stable Diffusion: благодаря открытому коду работа над моделями и различными дополнениями ведется буквально круглосуточно. Так что если у вас сегодня не получилось получить нужный результат, поверьте — через неделю кто-то наверняка выкатит новый модуль, который подойдет для реализации вашей идеи.

Также, если у вас возникают вопросы по поводу работы с нейросетью и вы не знаете с чего начать — на официальном сайте доступен раздел “Tutorials”, где можно найти гайды по использованию ИИ.

Системные требования и установка

Для того, чтобы установить нейросеть Stable Diffusion на ваш ПК, вам понадобится Windows 10/11, Linux или Mac, видеокарта NVIDIA, желательно с 4 ГБ и более видеопамяти, либо Mac на М1 или М2. Если у вас нет совместимой видеокарты — в настройках вы можете выбрать “Use CPU”, что позволит генерировать изображения, правда немного медленнее. Также необходимо 8 ГБ оперативной памяти и 20 ГБ свободного пространства на диске.

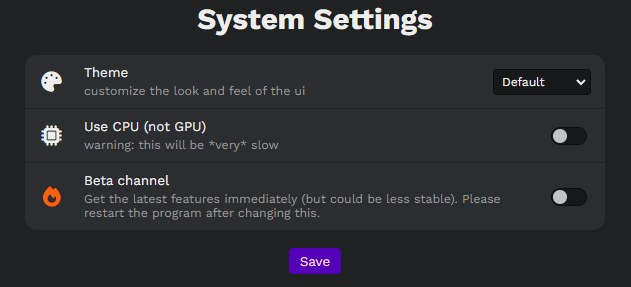

Обновляется программа каждый раз во время запуска по умолчанию до последней стабильной версии. Если вы захотите протестировать новые функции, вы всегда можете переключиться на бета-версию в настройках системы:

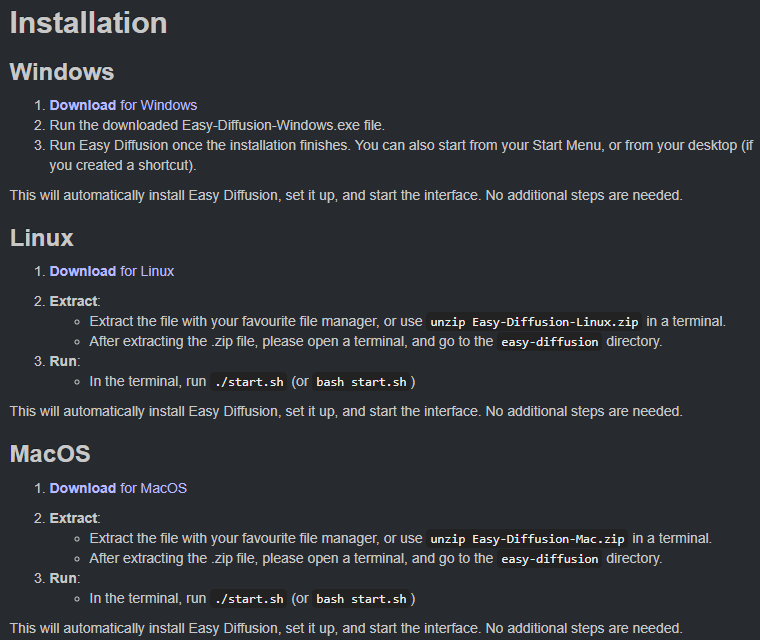

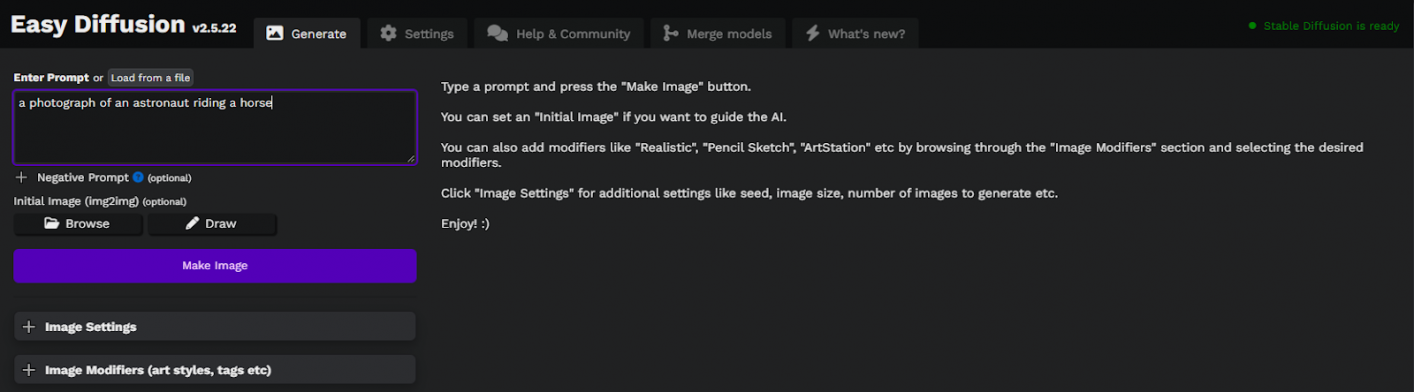

Для начала устанавливаем графическую оболочку нейросети Stable Diffusion — нужно перейти по ссылке, выбрать подходящую операционную систему, скачать и распаковать.

На диске появится папка “stable-diffusion-ui”, зайдите в неё и запустите файл “Start Stable Diffusion UI.cmd”. После окончания установки вы будете перенаправлены в браузер, где уже будет запущен интерфейс Stable Diffusion.

На данном этапе процесс установки не заканчивается — сейчас мы скачали лишь оболочку программы, теперь нам предстоит найти подходящую обученную модель, чтобы мы могли генерировать изображения в нужной стилистике.

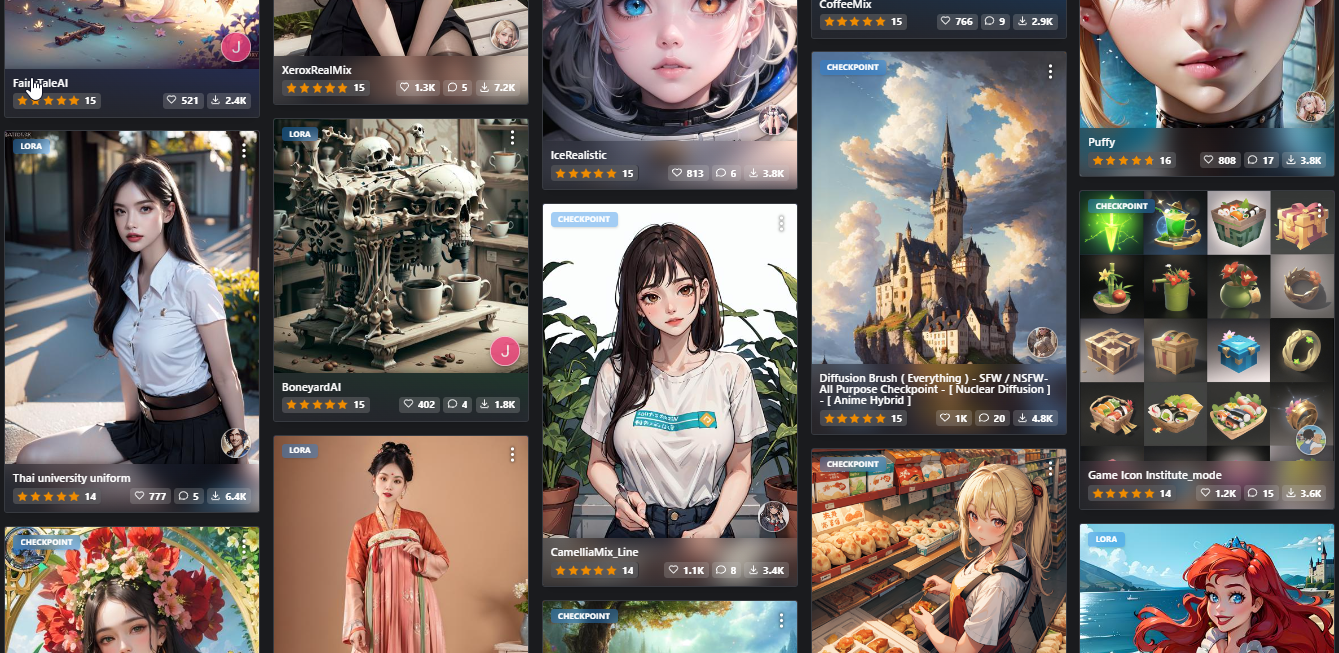

Найти их можно здесь. Каждая модель отвечает за определенную стилизацию изображения — какая-то рисует в стиле мультфильмов Disney, какая-то в стиле аниме, есть модели, работающие с генерацией реалистичных фото людей, 3D элементов и многое другое. Так что если вам хочется достичь определенного эффекта, придется поискать подходящую модель, а если идей нет, то всегда можно найти уйму интересных вариантов.

На данный момент оптимальной для генерации изображений людей считается модель Deliberate 2.0. Её-то мы и будем тестировать.

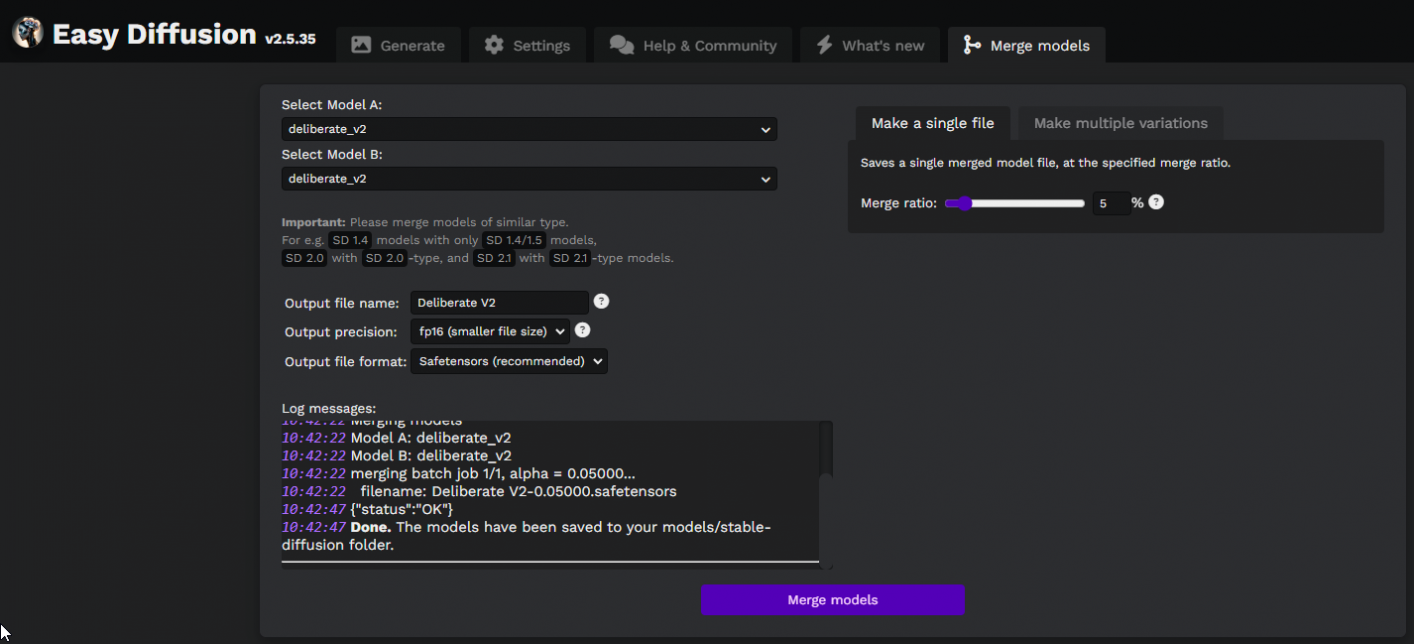

Для установки Deliberate 2.0:

1. Необходимо перенести скачанный файл в папку stable-diffusion-ui\models\stable-diffusion и перезагрузить нейронку.

2. Открыть настройки Stable Diffusion и выбрать нужную модель в выпадающем списке меню “Merge models”.

Что делать, если нет возможности установить программу?

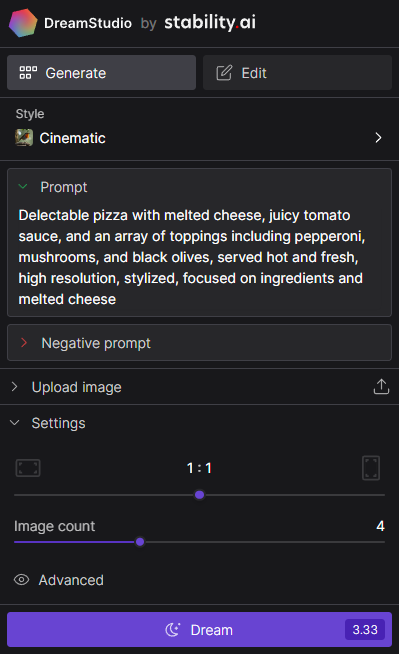

Для тех, кто не может воспользоваться ПК версией нейросети, Stability AI разработала упрощенную веб-версию Dream Studio. На сайте вы можете сгенерировать бесплатно до 200 изображений. Для работы с ИИ нужно зарегистрироваться или авторизоваться через аккаунт Google либо Discord.

На панели инструментов вы можете: выбрать стиль креатива, текстом заполнить промт, а также написать то, чего точно не должно быть на изображении, загрузить исходное изображение, выбрать подходящий размер и настроить количество изображений.

Наш запрос:

Результат:

Также разработчики создали бесплатный телеграм-бот без ограничений на количество генерируемых изображений. Единственное — бот работает в порядке живой очереди, так что если вы попали на пик его активности, придется подождать, либо бот перенаправит вас на сайт.

Учимся писать запрос

Для того, чтобы на выходе получить удовлетворительный результат, на сайте Stability AI есть отличный мануал, который поможет составить корректный текстовый запрос

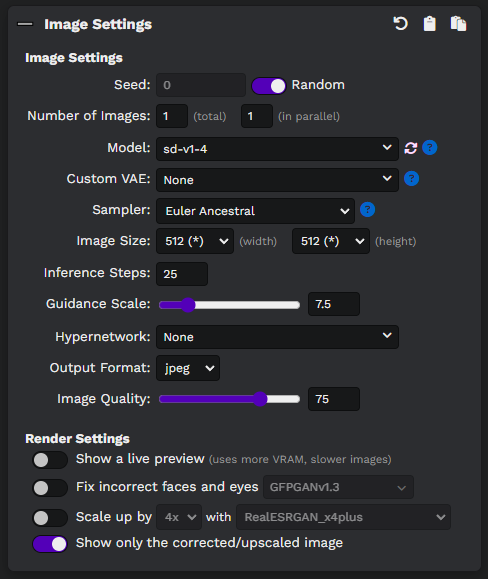

Для начала предлагаем выбрать настройки изображения и уже потом сгенерировать сам запрос:

1. Параметр “Seed” по умолчанию стоит рандомный, а это значит, что нейросеть будет выдавать разные результаты при одинаковом запросе.

2. Оптимальным вариантом будет генерировать изображения размером 512х512 пикселей, поскольку чем больший размер вы выбираете – тем больше идет нагрузка на вашу видеокарту. Самый простой способ — после генерации изображения улучшить разрешение с помощью сервисов апскейлинга.

3. Обратите внимание на количество шагов “Inference Steps” — чем больше число, тем лучше качество картинки на выходе, но и времени уйдет на это гораздо больше. Мы бы рекомендовали использовать число 50 и менее.

4. Параметр “Guidance Scale” напрямую отвечает за креативность изображения — чем меньше будет цифра, тем больше нейронка будет импровизировать, а чем больше, тем точнее будет реализован запрос. Если вы хотите точное воспроизведение вашего запроса, рекомендуем ставить значение от 8 до 12, но если готовы довериться ИИ — смело ставьте значение меньше и Stable Diffusion будет интерпретировать текстовое описание шире, не ограничиваясь изначальным запросом.

Что нужно знать о текстовом описании:

- Текстовое описание должно быть максимально точным, но нейронка воспринимает только первые 75 слов, учтите это при составлении запроса.

- Слова имеют значение — чем ближе они к началу описания, тем больший “вес” имеют для нейросети. Но если с этим возникнут проблемы вы всегда можете воспользоваться “:цифровое значение веса”, т.е. поставить, к примеру, “:65” после определенного набора слов, но общий вес должен быть равен 100. Схема должна выглядеть так — “Запрос к изображению:65, продолжение запроса:35”.

- Не стесняйтесь использовать синонимы, Stable Diffusion их понимает и будет точнее выдавать результат.

Если у вас возникают сложности при создании запросов, можно воспользоваться промптерами, чтобы облегчить себе задачу. Это специализированные сервисы, которые помогают более четко сформулировать запрос — вам лишь нужно составить описание, что вы хотите получить от нейросети, а сервис поможет подобрать дополнительные параметры. Попробуйте PromptoMania, LexicaArt, Phraser или Stable Diffusion Modifier Studies.

Категории ключевых слов, которые нам предлагает Stable Diffusion для составления запроса, предполагают определенный порядок слов для наилучшего результата:

- Объект — что вы хотите видеть на изображении. Нейросеть не умеет читать мысли, поэтому чем подробнее будет описание, тем лучше.

- Середина — это материал, который используется. Это может быть иллюстрация, 3D-визуализация, масляная живопись, фотография, 2д изображение и т.д.

- Стилистика изображения. Подразумевается художественный стиль, например сюрреализм, поп-арт, фантазия.

- Художник. Если вы хотите добавить стилистику, которая присуща определенному художнику, вы можете вписать эту информацию.

- Разрешение. Данная часть описания помогает с акцентами, например добавить детализацию и сделать фокус.

- Детали. Можно придать “особую” атмосферу благодаря описаниям — красивый, антиутопический, ледяной и т.д.

- Цвет. Вы можете контролировать цветовую гамму изображения, как в виде тона, так и цвета определенного объекта.

- Освещение. Вы можете попросить нейросеть сделать кинематографическое освещение или добавить темных акцентов.

Что получилось

Составленный запрос: Tiger in forest, hyperrealistic, highly detailed, Golden Hour, Neoclassical, Artstation. Выше мы писали о модели Deliberate 2.0, её мы тоже использовали во время генерации изображения.

Что выдала нейросеть:

Второй запрос: orange koi carp in a blue pond, highly detailed and sharp focus, beautiful, cinematic lighting, Artstation.

Итоги

Нейросеть Stable Diffusion — это отличный инструмент и хорошая альтернатива платным нейросетям, которые работают с изображениями. Конечно, с ИИ придется немного попотеть, поскольку выбор подходящей модели для обработки не происходит за секунду, но качество исходящих изображений и возможности программы приятно порадуют пользователей.

Вам была полезна эта статья?

1

0

Похожие статьи