6 апреля 2026

Что такое парсинг и как собирать данные с сайтов конкурентов

422

В бизнесе часто приходится собирать информацию с сайтов конкурентов. Например, анализировать цены и скидки на товары, отзывы покупателей, самые обсуждаемые темы в интернете. Сбор таких данных называется парсингом. Чтобы собрать большой объем информации руками, нужно много времени.

Избавить от рутины поможет специальная программа — парсер. Вы ставите задачу, и он соберет и сохранит нужную информацию в удобном для вас виде. В статье разобрались, что же такое парсеры и как с их помощью сэкономить десятки часов.

- Что можно парсить

- Какие есть ограничения для парсинга

- Какие бывают парсеры

- Топ парсеров под разные задачи

- Коротко: как собирать данные с сайтов

Что можно парсить

- Товары и их стоимость. Можно следить за конкурентами и вовремя делать скидки.

- Поисковые фразы. Узнавать, по каким словам и фразам люди ищут товары/услуги в интернете, и настраивать по ним рекламу.

- Битые ссылки. Для поиска ошибок на своем сайте.

- Идеи для контента. Можно собрать самые популярные темы из блогов конкурентов и понять, о чем стоит писать.

- Отзывы. Узнаете, что на самом деле думают покупатели о товаре или услуге.

Какие есть ограничения для парсинга

Несмотря на мощность и возможности программ, спарсить любой сайт в один клик получится не всегда. Владельцы сайтов защищают свои данные, поэтому при выборе парсера важно учитывать нюансы:

- Автоматизация и доступ. Самые простые парсеры умеют собирать данные только с открытых страниц. Если же нужна информация, которая спрятана в личном кабинете или еще глубже, обычный парсер не справится. Для подобных задач нужны более продвинутые инструменты, которые умеют регистрироваться на сайте и имитировать действия реального человека.

- Защита от роботов. Сайты не любят, когда на них слишком часто заходят с одного IP. Если парсер начнет отправлять сотни запросов в секунду, сервер расценит это как DDOS-атаку и заблокирует ваш IP-адрес. Чтобы не попасть в бан, парсер должен вести себя, как человек: делать паузы между действиями и заходить под разными именами. Также нужно использовать прокси с ротацией, чтобы постоянно менять адреса, с которых идет сбор данных.

- Ловушки для парсеров. Крупные компании устанавливают на свои сайты специальные барьеры:

- Капчи. Парсер не может пройти картинки с пазлами и буквами без специальных сервисов-дешифраторов.

- Скрытые ссылки. Такие ссылки человек не видит, а парсер видит их через код и может по ним переходить. Система защиты сайта знает, что реальный человек никак не мог по ним перейти и мгновенно блокирует IP-адрес.

- Динамический контент. Большинство сайтов сейчас используют динамический контент — когда информация подгружается постепенно, по мере прокручивания страницы вниз. Если на таких сайтах использовать простой парсер, он увидит только шапку сайта и пустые блоки, так как простой парсер не умеет прокручивать страницу вниз и ждать, когда погрузятся все данные. Для таких сайтов нужны парсеры, которые умеют имитировать прокрутку, ждать полной загрузки и только потом забирать данные.

Какие бывают парсеры

Существует три вида парсеров: облачные, десктопные и браузерные.

Облачные парсеры. Это онлайн-сервисы, которые работают на серверах разработчика. Их не нужно устанавливать на компьютер: регистрируетесь на сайте парсера, вставляете ссылку на страницу, с которой нужно собрать данные, и задаете нужные параметры сбора информации.

Плюсы: работают автономно и не нагружают ваш компьютер. В облачные парсеры часто уже встроены прокси и антикапча.

Минусы: высокая стоимость и ежемесячная подписка.

Десктопные парсеры. Это софт, который нужно устанавливать на свой компьютер. Если облачные парсеры — это аренда чужих мощностей, то здесь вы используете ресурсы своего железа. В парсер нужно загрузить список ссылок и настроить параметры сбора данных. Программа начинает отправлять запросы с вашего компьютера через подключенные прокси, имитируя входы на сайт десятков пользователей одновременно.

Плюсы: максимальная скорость работы и полный контроль действий. На некоторые парсеры можно купить пожизненную лицензию и собирать данные в любых объемах.

Минусы: нужен мощный процессор и много оперативной памяти. Нужно отдельно покупать прокси и подключать сервисы антикапчи.

Браузерные расширения. Это расширения, которые устанавливаются прямо в браузере. Вы открываете нужный сайт, нажимаете на иконку установленного расширения и выделяете на сайте то, что хотите собрать.

Плюсы: простой и понятный инструмент. Идеально подходит, если нужно разово собрать данные с одной-двух страниц.

Минусы: работают медленно, не подходят для сбора больших объемов данных. Если закрыть вкладку браузера, сбор информации остановится.

Топ парсеров под разные задачи

Собрали проверенные парсеры, ориентированные на разные задачи и уровень сложности сбора данных.

Легкий уровень

Идеально подходят для новичков и разовых задач, когда нужно быстро собрать данные.

1. Web Scraper

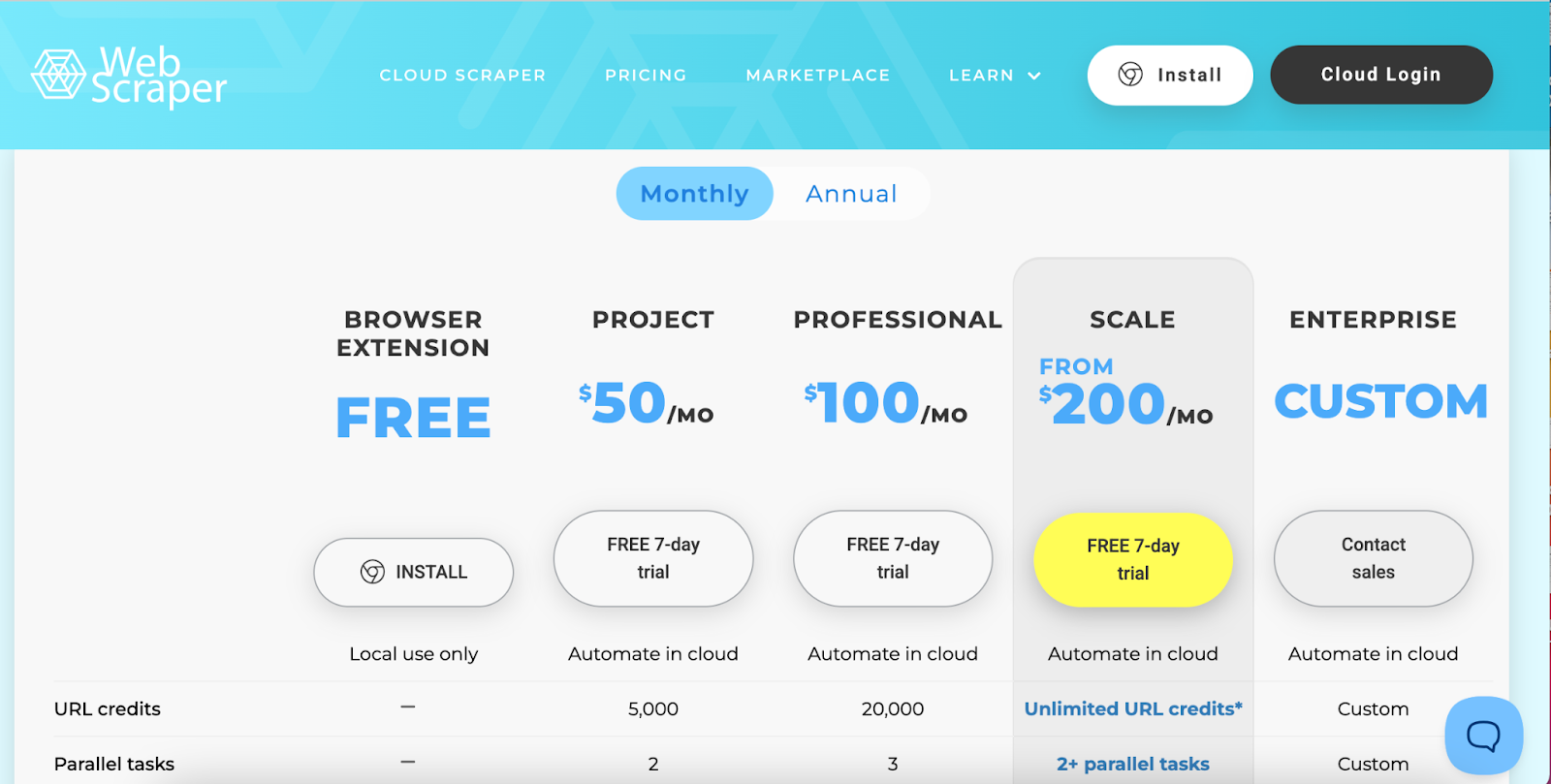

Популярный парсер с расширением для Chrome и Firefox. У инструмента есть две версии работы: бесплатное расширение для браузера и платная облачная платформа.

Функции:

- Понимает сложные сайты. Парсер не просто сканирует одну страницу, а умеет переходить по категориям и подкатегориям, заходить в карточки товаров и собирать оттуда подробное описание.

- Работает с динамическими страницами. Если на сайте контент подгружается только при прокрутке страницы или при нажатии кнопки «Показать еще», Web Scraper подождет загрузку и соберет все нужные данные.

- Гибкая настройка. Вы сами настраиваете карту сайта внутри расширения. Это позволяет подстроиться под любой дизайн сайта и вытащить данные даже оттуда, откуда другие простые парсеры не могут.

- Удобный экспорт. Все, что собрал парсер, можно за пару кликов отправить в таблицу.

|

Бесплатное расширение |

Платные пакеты |

|

|

2. Instant Data Scraper

Максимально простое расширение для тех, кому нужно собрать данные в один клик без настроек и регистрации. Парсер использует ИИ, чтобы находить данные с товарами и ценами.

Функции:

- Автоматический поиск. Вы открываете расширение на нужной странице, и парсер сам подсвечивает область для сбора. Если результат не устраивает, можно задать расширенные параметры для более точного анализа.

- Распознавание кнопок. Видит кнопки «Next» или «Далее», чтобы перелистывать и собирать данные в один файл.

- Настройка задержки. Можно выставить паузу между запросами, чтобы имитировать поведение человека.

- Экспорт данных. Может собирать собранные данные в таблицу Excel или файл CSV.

Тарифы: полностью бесплатный.

Средний уровень

Инструменты для тех, кому нужно парсить данные регулярно и в больших объемах.

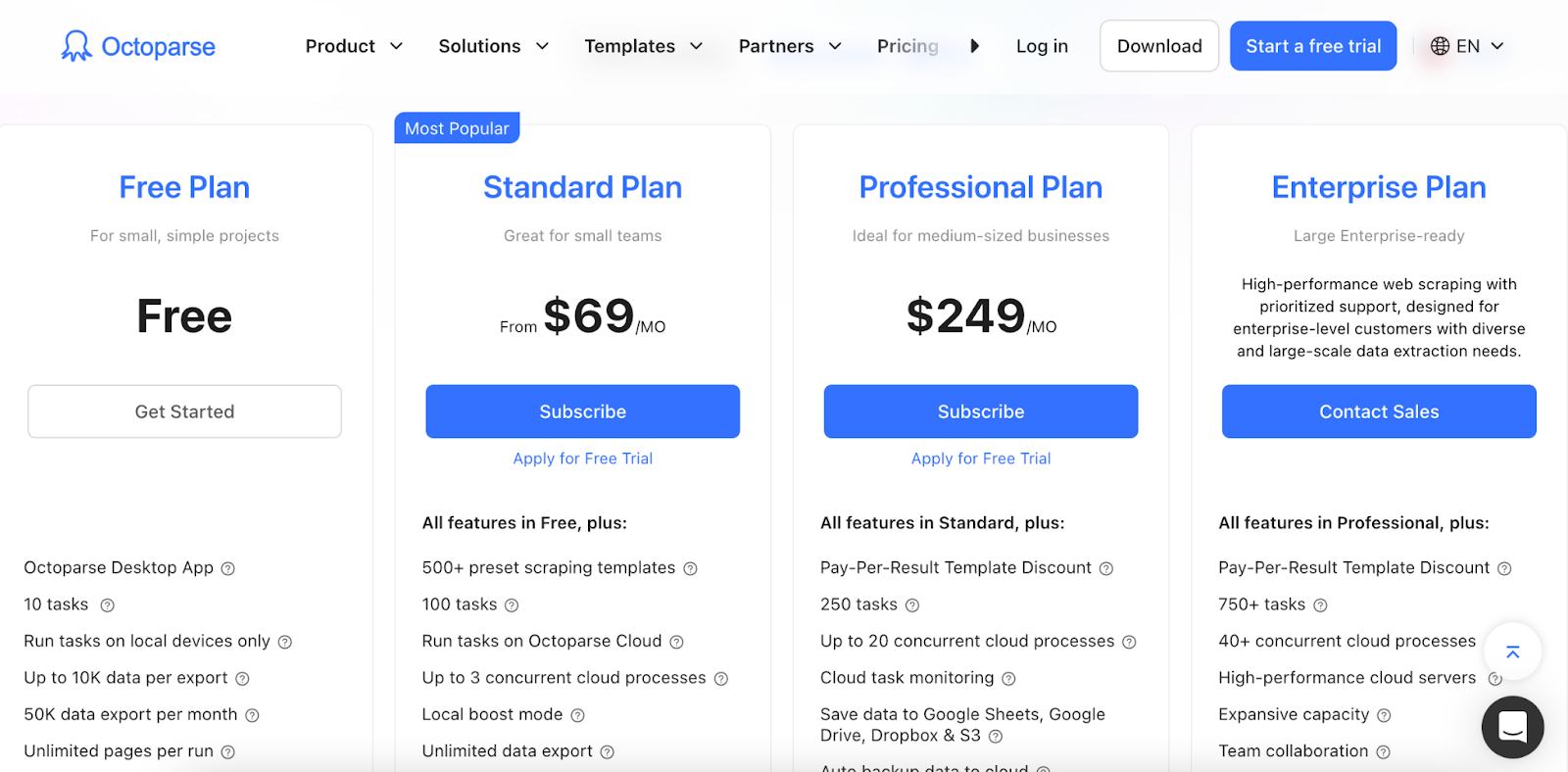

1. Octoparse

Один из самых мощных облачных парсеров, который подходит для новичков и профессионалов. Парсер работает как браузер со встроенным визуальным редактором. Вы открываете нужный сайт прямо внутри программы и кликаете по элементам (ценам, заголовкам), а софт сам запоминает последовательность действий и превращает их в алгоритм.

Функции:

- Визуальный конструктор. Весь процесс сбора данных отображается в виде понятной схемы. Вы видите каждый шаг парсера: на что кликнул, когда подождал загрузку и что именно скопировал.

- Обход блокировок. В программу встроены инструменты для автоматической смены IP и очистки куки.

- Работа со сложными элементами. Парсер легко справляется с выпадающими списками, всплывающими окнами и прокруткой страниц.

- Облачный запуск. После настройки задачу можно отправить на сервер Octoparse. Сбор данных будет идти 24/7, даже если вы закроете программу и выключите компьютер.

|

Бесплатная версия |

Платные пакеты |

|

|

2. Browse AI

Простой и удобный облачный парсер, который использует ИИ и машинное обучение. Вместо настройки схем вы записываете свои действия, а парсер их запоминает и повторяет. Помимо сайта, у сервиса также есть расширение для Google, которое работает совместно с Robot Studio. Оно помогает создавать роботов, которые извлекают и отслеживают данные из вашего браузера.

Функции:

- Обучение. Вы один раз вручную собираете нужные данные. Парсер запоминает ваши клики, движения и переходы и начинает выполнять эти действия автоматически.

- Мониторинг. Инструмент умеет следить за конкретным блоком на странице (например, за ценой товара или наличием скидки) и отправляет изменения на почту или в Telegram.

- Готовые шаблоны. В Browse AI есть настроенные роботы для площадок eBay, Booking, Amazon.

- Синхронизация с другими сервисами. Собранные данные можно мгновенно передавать в приложения вроде Google таблицы.

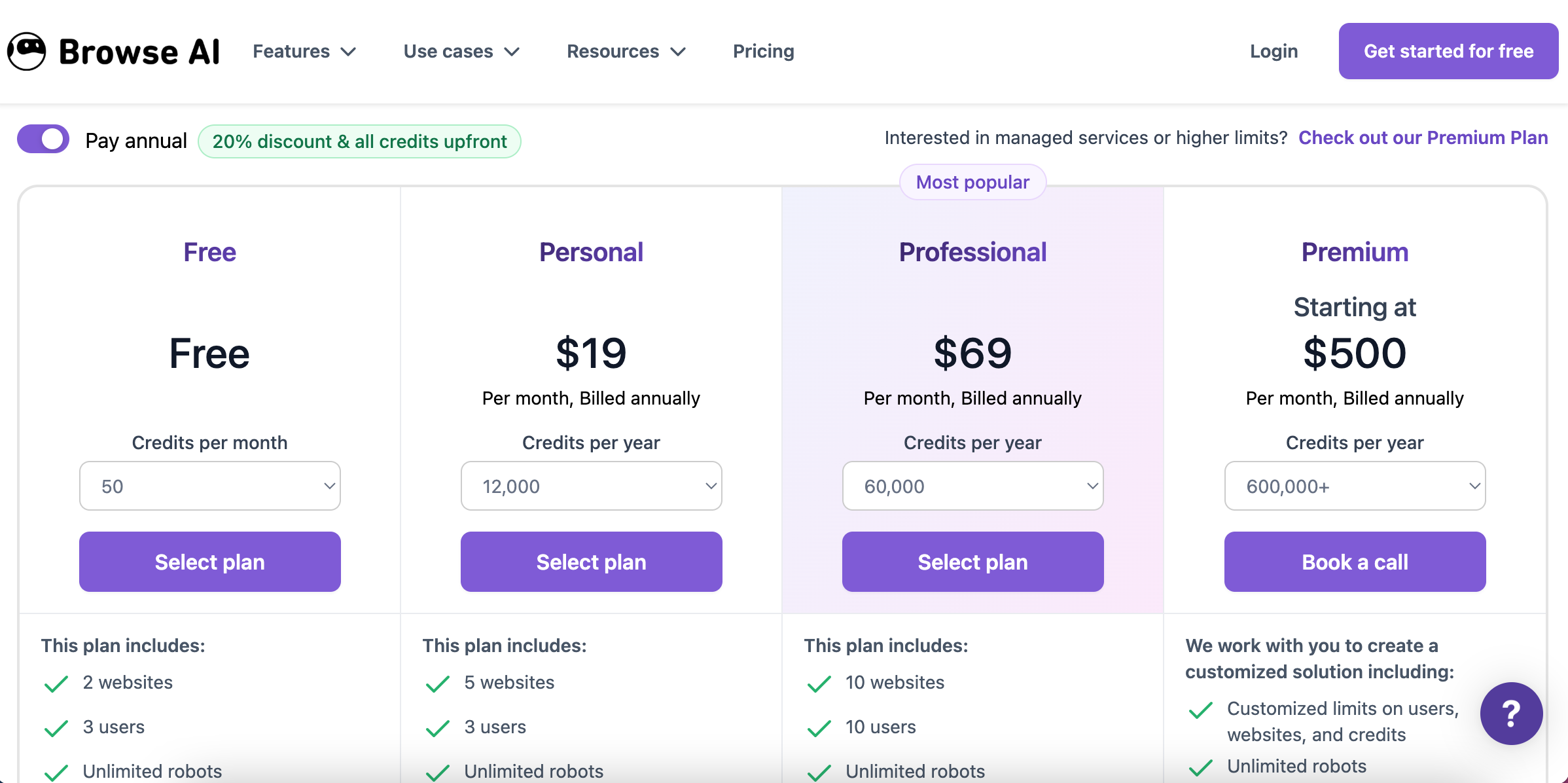

|

Бесплатный тариф |

Платные пакеты |

|

|

Профи уровень

Инструменты с максимальной производительностью для тех, кому нужны миллионы строк данных, обход самых сложных систем защиты, проверка SEO-параметров или поиск аудитории.

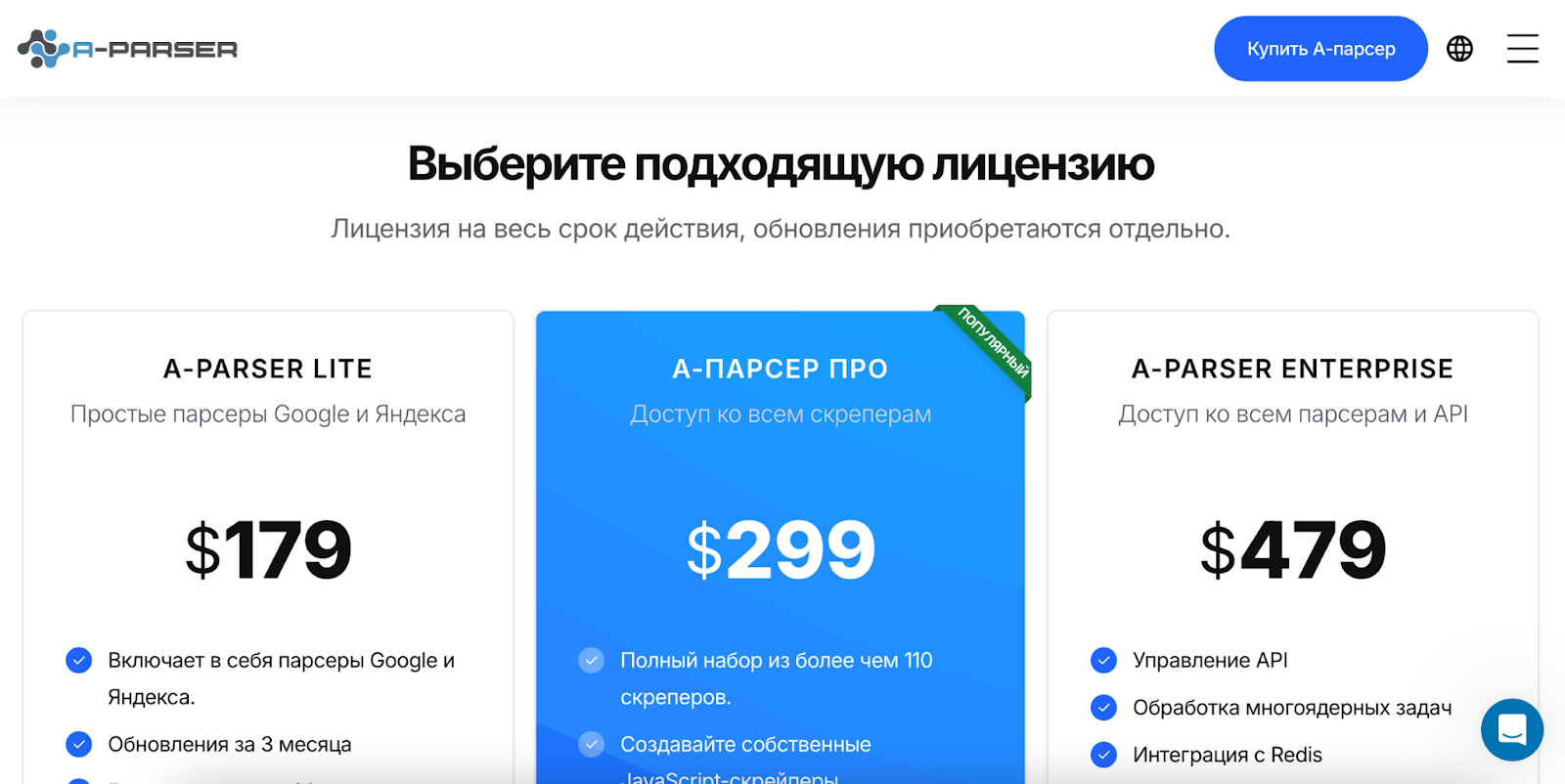

1. A-Parser

A-Parser — мощный инструмент для автоматизации сбора данных. Работает на вашем железе или на выделенном сервере и позволяет создавать сложнейшие цепочки парсинга.

Функции:

- Высокая скорость. Можно запускать тысячи запросов одновременно.

- Огромная база готовых настроек. Доступно более 110+ готовых парсеров для самых популярных площадок: Google/Yandex, соцсети, интернет-магазины и рекламные сети.

- Гибкие настройки фильтрации. Можно мгновенно очищать данные от мусора, менять формат сбора и вывода данных и собирать результаты из разных источников в одну таблицу.

- Техничка A-Parser поддерживает полную интеграцию распознавания капчи и прокси через API. Благодаря их встроенным модулям, парсер позволяет автоматизировать обход проверок на человечность.

Тарифы: от $179 до $479 за пожизненную лицензию.

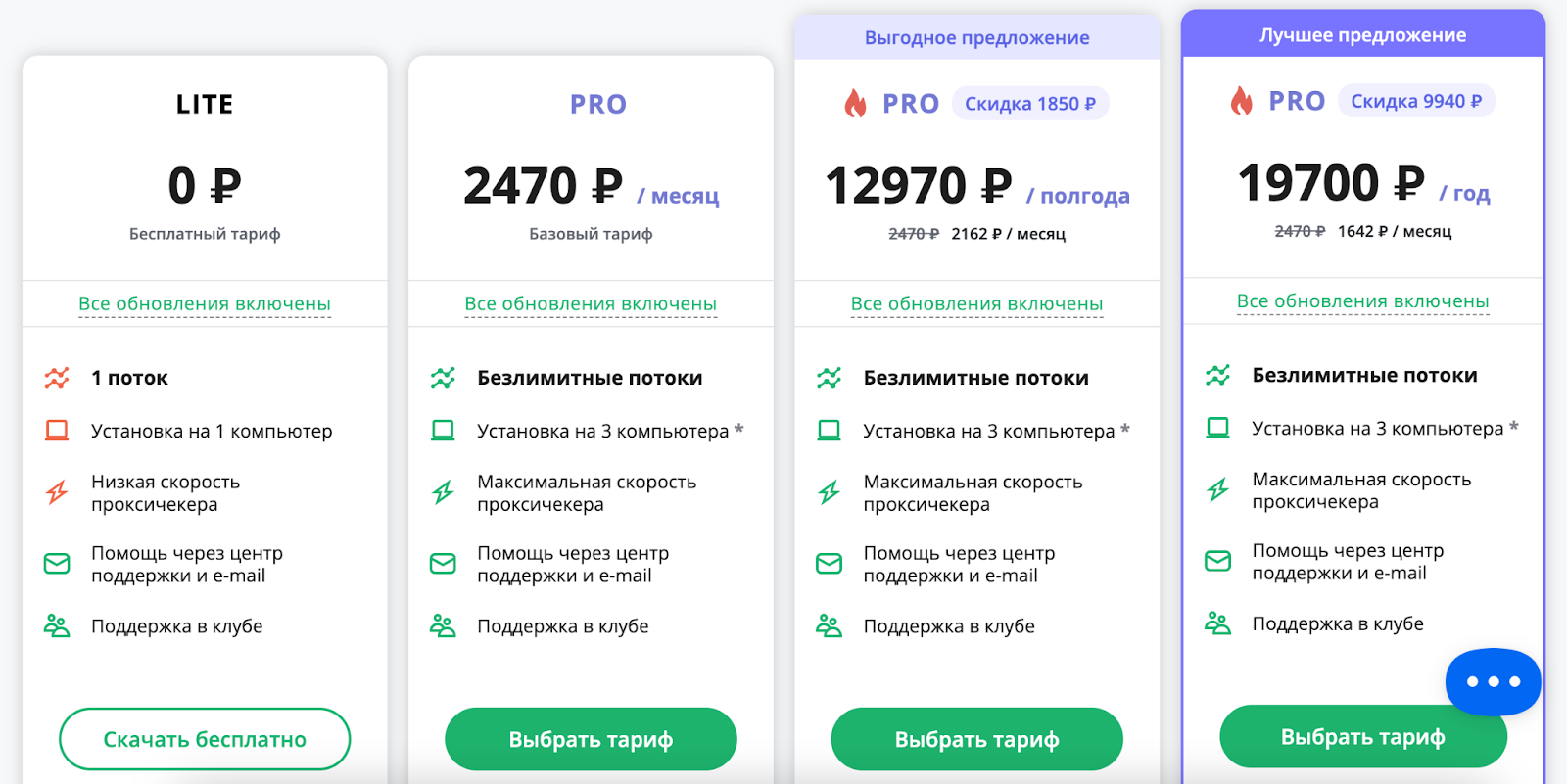

2. ZennoPoster

Инструмент для полной автоматизации работы в браузере. Он умеет имитировать действия реального человека: регистрировать аккаунты, заполнять формы, кликать по кнопкам и постить контент.

Функции:

- Визуальный конструктор. Знание кода не нужно. Вы просто стоите логическую цепочку для парсера в интерфейсе самой программы.

- Работа в несколько потоков. Можно запускать сотни автономных сессий одновременно. Это в десятки раз ускоряет сбор данных и выполнение однотипных задач.

- Обход сложных защит. Благодаря продвинутой эмуляции — отпечатков браузера, движений мыши, шрифтов — инструмент помогает имитировать действия реального человека.

- Работает на базе Chrome и Firefox. Это позволяет без проблем парсить даже самые тяжелые сайты JavaScript со сложной динамической подгрузкой.

|

Бесплатная версия |

Платные пакеты |

|

|

Коротко: как собирать данные с сайтов

Что такое парсинг. Это автоматический сбор данных с веб-страниц или с сайтов.

Что можно парсить. Можно парсить цены конкурентов, списки товаров с характеристиками, контакты потенциальных клиентов, поисковые запросы и отзывы покупателей.

Какие есть ограничения. Главный барьер — системы защиты сайтов. Они блокируют частые запросы с одного IP, выставляют капчи и прячут данные в личных кабинетах.

Виды парсеров. Существует три вида: облачные, десктопные и браузерные.

Как выбрать парсер:

- Web Scraper и Instant Data Scraper подходят для разовых задач и простых сайтов.

- Octoparse и Browse AI идеальны для регулярного сбора данных без нагрузки на свой компьютер. Они работают 24/7, сами меняют IP и разгадывают капчи.

- A-Parser и ZennoPoster профессиональные парсеры для больших команд. Работают в сотни потоков на высокой скорости и умеют полностью имитировать поведение человека.

Вам была полезна эта статья?

2

0

Похожие статьи