6 апреля 2023

Искусственный интеллект опасен?

13501

Искусственный интеллект уже стал одной из самых обсуждаемых тем в 2023 году. В то время как некоторые недовольные были сосредоточены на том, что нейросети на основе ИИ сокращают рабочие места, другие забеспокоились о его потенциальном контроле над человечеством. И это было бы смешно, если бы не новость прошлой недели о том, что чат-бот Eliza за шесть недель довел собеседника до самоубийства.

Остановить развитие ИИ?

По словам Элиезера Юдковского, исследователя искусственного интеллекта, появление этой технологии может разрушить существующее человеческое общество. Юдковский давно исследует проблемы технологической сингулярности и выступает за создание дружественного ИИ, предупреждая о том, что угроза для человечества возникнет, если будет выпущена более продвинутая система.

По его словам, развитие ИИ в соответствии с современной тенденцией приведет к созданию системы, от действий которой «умрет каждый представитель человеческого вида и вся биологическая жизнь на Земле».

Можно было бы не принимать всерьез слова автора книги «Гарри Поттер и методы рационального мышления», но Юдковский не единственный, кто так думает. Буквально на прошлой неделе, 29 марта 2023 года, более 1000 экспертов по искусственному интеллекту подписали открытое письмо с призывом приостановить любое дальнейшее развитие технологии ИИ, более мощных, чем GPT-4, не менее чем на 6 месяцев. Юдковский, кстати, не стал участвовать в подписании, поскольку, по его словам, письмо не затрагивает основные проблемы, связанные с вопросом ИИ.

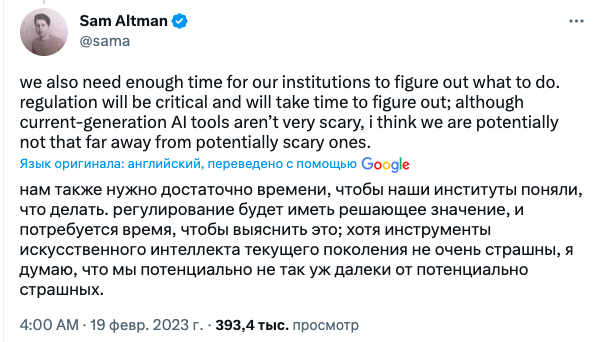

«Потенциально страшный» ИИ

Похоже, не только эксперты выразили свою озабоченность по этому поводу. Генеральный директор OpenAI, материнской компании ChatGPT, сам подчеркнул опасность развития технологии. Еще в феврале 2023 года Сэм Альтман отметил, что мир, возможно, не так уж далек от «потенциально страшных» инструментов искусственного интеллекта.

Чем искусственный интеллект опасен? Не стоит вспоминать многочисленные художественные произведения о техногенном постапокалипсисе во главе с «Терминатором». Искусственный интеллект УЖЕ используется для злоупотребления технологиями, зачастую применяется без надлежащего человеческого контроля и игнорирует этические вопросы. Создание фейковых материалов, манипуляции общественным мнением и кибератаки под руководством ИИ - УЖЕ реальность.

В то время как несколько стран пытаются взять на себя инициативу в игре с ИИ, некоторые другие принимают меры предосторожности. Например, Италия недавно запретила Replika.ai, а вслед за ней и ChatGPT. Официально - из-за незаконного сбора персональных данных пользователей. Ряд других стран, среди которых Китай, Афганистан, Куба, Непал, Венесуэла и Сирия, ограничивает доступ к продукту от OpenAI. Многие школы и университеты по всему миру запретили своим ученикам использование чат-бота.

Пока эксперты не уверены, перевешивают ли возможные негативные последствия плюсы использования ИИ, временная остановка быстро развивающейся технологии кажется поспешным решением.

Вам была полезна эта статья?

0

0

Похожие статьи