27 апреля 2026

Топ-6 нейросетей для генерации видео

330

Одна из самых хайповых ниш для заработка в 2026 году — постинг нейросетевых видео. Одни коучи советуют выходить на OnlyFans с ИИ-моделями, вторые подключать YouTube-монетизацию, а третьи сливать трафик на гемблинг-продукты.

Какой бы вариант заработка вы ни выбрали, в первую очередь нужно определиться с нейросетью. У каждого ИИ-генератора свои сильные и слабые стороны: цена, пул инструментов, уровень понимания промптов и не только.

Нашим читателям не придется тратить время на ресерч, так как команда Conversion составила подборку из 6 нейросетей для генерации видео, проверила их на практике и сравнила друг с другом.

- Как выбрать нейросеть для генерации видеороликов

- Топ нейросетей для генерации видео

- Сравнительная таблица нейросетей для видео

Как выбрать нейросеть для генерации видеороликов

Чтобы старт выдался удачным, нужно найти нейросеть, которая подходит конкретно под вашу задачу.

Стиль рисовки. На главных страницах большинства сервисов для создания роликов красуются слоганы в стиле «Сгенерируй видео своей мечты». Загвоздка в том, что нейросети учатся на разных массивах информации. Специализация ИИ-модели определяется тем, какой тип контента преобладал в обучении: фотореализм или мультипликация.

Генерировать документальный фильм на манер Лапенко в нейросети, заточенной под анимацию — заведомо проигрышная стратегия, так как модель привыкла к упрощенной физике и ярким оттенкам. В этом случае креатор рискует нарваться на артефакты: неестественную мимику, блики и кривые текстуры.

Удержание консистентности. Некоторые генераторы роликов грешат тем, что не умеют удерживать консистентность — внешность персонажей и окружение меняются от генерации к генерации. Многослойные запросы и графические референсы не всегда решают проблему. Такие сервисы сгодятся для юмористического нейрослопа, но не подойдут для создания ИИ-моделей или инфлюенсеров.

Другие генераторы, напротив, понимают креаторов с полупромпта — достаточно единожды прописать запрет на изменения внешности героев и «задника».

Работа с аудио. Генерировать ролик, озвучивать его вручную или через ИИ, а потом заморачиваться с липсинком может быть тяжело начинающим креаторам. В 2026 году есть генераторы видео, которые освоили липсинк и умеют озвучивать персонажей — так один инструмент закрывает сразу несколько задач, что экономит не только время, но и деньги.

Встроенный видеоредактор. На текущий момент нейросети научились генерировать сносные видео, но до идеала еще далеко — креаторам приходится править за ИИ вручную.

Большинство контентмейкеров дорабатывают ролики в CapCut и AE, так как встроенным видеоредактором могут похвастаться не все сервисы. Если такой есть, можно экономить по 2–3 часа в день.

Цена. Стоимость тарифных планов определяется обилием внутренних инструментов и жадностью разработчиков. Цены на месячные подписки варьируются от $3 до $200.

Однако у некоторых сервисов есть «костыли», которые позволяют создавать ролики бесплатно или с внушительной скидкой.

Топ нейросетей для генерации видео

С критериями отбора нейросетей разобрались, теперь поговорим о конкретных сервисах.

Чтобы приблизиться к объективности, мы взяли стоковую фотографию робота. Задача нейросетей — сгенерировать 2 сцены: в первой персонаж идет по оживленной улице, а во второй сидит в кафе за столиком и произносит фразу «Доброе утро».

Google Veo

- Стиль: фотореализм.

- Консистентность: продвинутая.

- Работа с аудио: озвучка персонажей, липсинк и фоновые звуки.

- Встроенный видеоредактор: упрощенный — работа с объектами и переходами.

- Цена: $19,99 в месяц через Google Flow, но есть «костыли» для бесплатного использования.

Google Veo — нейросеть, с которой начались юмористические ролики с социальными опросами на российских улицах.

Помимо продвинутой фотореалистичности и правдоподобной физики, креаторы полюбили этот сервис за:

- управляемость — автор может управлять камерой и получать ролики с разных ракурсов;

- понимание композиции — ИИ-модель выстраивает сцены с множеством объектов и практически не галлюцинирует;

- поддержку аудио — можно озвучить персонажа на русском языке с автоматическим липсинком, наложить звуковые эффекты и фоновое сопровождение;

- точное следование промпту — Google Veo безошибочно воспроизводит длинные промпты, не добавляя «отсебятины».

Без минусов здесь не обошлось: юзеры отмечают, что эта ИИ-модель воспринимает промпты только на английском языке, а максимальная продолжительность ролика составляет 8 секунд.

Чтобы пользоваться Veo, нужно создать профиль в Google AI Studio. Если авторизоваться в этом сервисе с российского аккаунта, откроется такое окно.

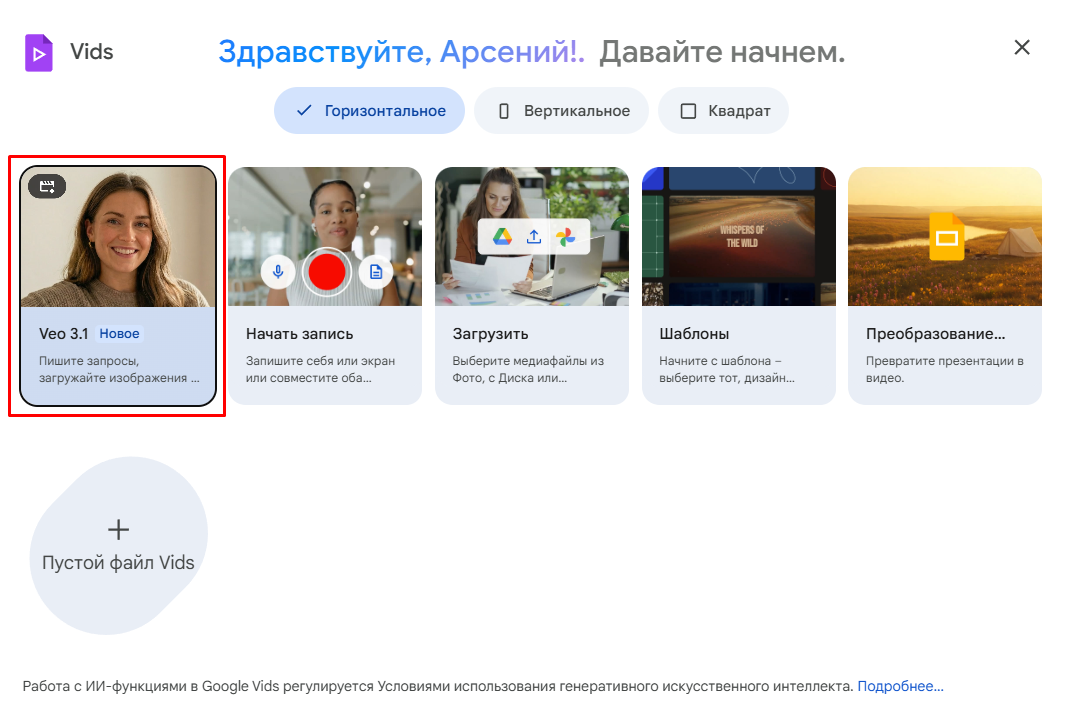

Нейроэнтузиасты нашли «бреши в обороне» Google и поделились тонной способов по обходу региональных ограничений. Один из таких — Google Vids, внутри которого лежит модель Veo 3.1.

Пользоваться Veo внутри этого хаба можно бесплатно, но месячный лимит составляет 25 роликов.

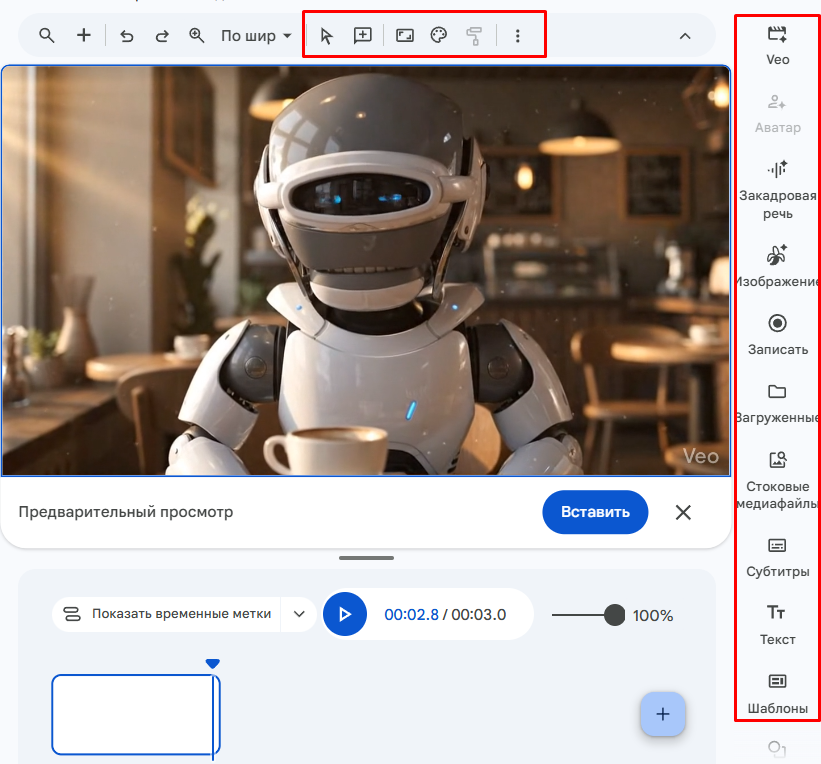

Теперь проверим, какие ролики сгенерирует нейросеть.

С первой сценой ИИ-модель справилась отлично. Робот выглядит реалистично, а звуки шагов ощущаются естественно. Единственный недостаток — нет городского шума.

Вторая сцена не удалась — фраза «Доброе утро» произносится в никуда, липсинк сломался, а робот говорит нечленораздельную кашу.

Главный минус обеих сцен в том, что Veo всегда использует изображение-референс в качестве стартового кадра — интро придется обрезать вручную.

Обратите внимание, что в Google Vids есть редактор, где можно поэкспериментировать с анимациями, добавить текст или отдельно сгенерировать закадровую речь — на этом его плюсы заканчиваются.

Kling AI

- Стиль: фотореализм.

- Консистентность: продвинутая.

- Работа с аудио: озвучка персонажей, липсинк, фоновые звуки и ASMR.

- Встроенный видеоредактор: базовый — редактирование через промпты.

- Цена: $6,99 в месяц за тариф, который включает 660 кредитов — «костыли» есть, но проще абузить триал на официальном сайте.

Kling AI — китайская нейросеть для генерации видеороликов, первая версия которой вышла на рынок в 2024 году. Основные фишки этого генератора заключаются в продвинутой физике и обилии внутренних инструментов.

Контентмейкеры любят этот сервис за:

- вариативность — Kling — мультитул, где можно генерировать классические ролики, картинки, «говорящие головы», озвучку и текстовое наполнение видео;

- продвинутое управление движениями персонажа — можно загрузить видеореференс или выбрать готовый паттерн, с которого будут скопированы движения;

- режим холста — здесь можно кадрировать сцены и делать наброски, в том числе в командном режиме.

Разработчики регулярно обновляют свой продукт. Например, в последнем апдейте добавили голосовое управление.

Если вы не планируете покупать платную подписку, придется довольствоваться долгой очередью на генерацию и 66 кредитами — этого хватит для создания трех роликов через устаревшие модели. Радует, что Kling AI не вводил никаких ограничений для россиян.

С теорией разобрались, теперь протестируем сервис на практике.

Kling не понял, что видео должно быть в кинематографическом стиле. Массовка скорее похожа на персонажей из Sims, чем на реальных людей: декораций это тоже касается.

Со второй сценой случилась беда — наш робот стоял на столе, а не сидел за ним. На третьей секунде шар превратился в подобие бокала, еще место «Доброе утро» мы получили мычание с закрытым ртом. Заметим, что генерация второй сцены заняла 40 минут.

Мы генерировали ролики через модель Kling AI 2.5: в противном случае нам не хватило бы кредитов на тестирование. Если использовать более продвинутые версии, результат будет более качественным и быстрым.

Seedance

- Стиль: фотореализм/мультипликация.

- Консистентность: высокая.

- Работа с аудио: озвучка персонажей, липсинк, фоновые звуки.

- Встроенный видеоредактор: базовый — редактирование через промпты

- Цена: €17 за месячный тариф в Dreamina, который включает 1 575 кредитов — «костыли» есть, но проще абузить триал на официальном сайте.

Seedance — нейросеть для генерации роликов от компании ByteDance, которая ответственна за разработку TikTok. Первая версия модели появилась летом 2025 года, и тогда комьюнити встретило новинку прохладно, но все изменилось с релизом Seedance 2.0.

Креаторы сходятся во мнении, что в 2026 году у этой нейросети нет конкурентов в плане кинематографичности, реализма и качества картинки. Еще аудитория высоко оценила Seedance за:

- точечный контроль над сценой — можно задать движение камеры, скорость зума и не только;

- консистентность — креаторы отмечают, что Seedance не видоизменяет внешность персонажей, окружение и мелкие детали по типу принтов на одежде;

- продвинутые алгоритмы — внутренний движок может сделать режиссерскую склейку при переходе с общего плана на ближний, если посчитает нужным;

- продолжительность роликов — максимальная длина видео — 15 секунд.

Главная проблема Seedance в доступности — отдельного сайта у нейросети нет, а модель интегрирована в китайские чат-боты, которые моментально детектят абуз. Мы остановились на Dreamina: в рамках триала здесь дают 120 кредитов, которых хватит на 2 ролика по 5 секунд.

Теперь проверим, как Seedance 2.0 справится с нашим заданием.

С первой сценой у нейросети не возникло никаких проблем — ролик полностью соответствует промпту, а стартовый кадр не попал в интро. Удивляет то, что генерация заняла всего 2 минуты.

Ко второй сцене тоже не придраться — внешность робота не поменялась, фраза произнесена четко, а губы двигаются в такт словам.

Seedance 2.0 генерирует отличные ролики, но бесплатного тарифа не хватит для полноценной работы. Абузить триал никто не запрещал, но тратить по 20 минут на фарм Google-аккаунта, чтобы сделать 2 видео — сомнительная тактика.

Wan

- Стиль: фотореализм.

- Консистентность: продвинутая.

- Работа с аудио: озвучка персонажей, липсинк, фоновые звуки.

- Встроенный видеоредактор: базовый — редактирование через промпты.

- Цена: $5 в месяц за базовый тариф, который включает 300 токенов, «костылей» нет.

Wan — китайский генератор роликов, разработанный компанией Alibaba. Этот продукт появился на рынке в январе 2025 года, но тогда контентмейкеры жаловались на обилие артефактов и общую недоработанность. Хайп пришел к Wan в апреле 2026 года одновременно с релизом версии 2.7.

Преимущества Wan:

- продвинутая консистентность — можно загрузить до 5 роликов-референсов, чтобы модель запомнила персонажа вплоть до мелких деталей;

- стабильность — юзеры отмечают, что Wan практически не галлюцинирует, а артефакты встречаются крайне редко;

- сценарный режим — если заморачиваться со сценарием не хочется, можно задать краткий промпт, а остальную работу ИИ возьмет на себя;

- гибкое управление камерой — помимо классического управления ракурсами, можно «заменить» тип объектива.

Весомый плюс в копилку Wan — отдельный сайт. Бегать по агрегаторам и прибегать к «костылям» не придется.

Посмотрим, как эта нейросеть выполнит нашу задачу.

Если не считать смену ракурсов и наложения речи, о которых никто не просил, Wan неплохо справился с первой сценой.

Вторая сцена не удалась — речь на английском языке, а губы не попадают в такт произносимым словам. Не исключено, что Wan еще не научился распознавать русский язык.

Wan не предлагает полноценного триала. Каждый день вам будут начислять по 10 кредитов, которых хватит на один ролик — придется раскошелиться.

Runway Gen

- Стиль: фотореализм/мультипликация.

- Консистентность: продвинутая.

- Работа с аудио: озвучка персонажей, липсинк, фоновые звуки.

- Встроенный видеоредактор: базовый — редактирование через промпты.

- Цена: $9,9 в месяц за базовый тариф, который включает 1 000 токенов, «костылей» нет

Runway Gen — генератор видео, разработанный одноименной компанией в 2023 году. На старте эта нейросеть оставалась в тени «старших братьев». В декабре 2025 года вышло очередное обновление — Gen 4.5 и ролики, сгенерированные в этом сервисе, завирусились в сети.

Команда разработчиков делает акцент на том, что их продукт генерирует не просто хорошие, а реалистичные ролики. Креаторы оценили Runway Gen 4.5 за:

- разнообразие режимов — вместо диалогового окна Runway предлагает отдельные инструменты, заточенные под конкретную задачу — апскейл, редактирование, построение сцен, удаление объектов из видео и не только;

- внутренний конструктор — собирать сцены можно покадрово через визуальный конструктор, интерфейс которого напоминает сервисы для сборки Telegram-ботов;

- продвинутую генерацию цифровых аватаров — можно создавать «говорящие головы» для zoom-созвонов, UGC-роликов — есть готовые пресеты, но никто не запрещает генерировать с нуля;

- улучшенную физику — Runway Gen 4.5 фокусируется не только на главных героях и окружении, но и на мелких деталях.

Сразу после авторизации через Google-аккаунт на баланс зачислят 125 токенов, которых хватит на 2 ролика.

Теперь проверим, соответствуют ли хвалебные отзывы пользователей реальности.

В первой сцене нейросеть отошла от промпта. Мы просили сделать видео в анфас, но Runway сделал нарезку ракурсов. Добавим, что окружение выглядит картонным.

Со второй сценой у ИИ возникла аналогичная проблема — робот должен смотреть прямо в камеру, а вместо этого получилась нарезка ракурсов. Фраза «Доброе утро» произнесена криво, а рот так и не открылся.

Pika

- Стиль: мультипликация/фотореалистичность.

- Консистентность: продвинутая.

- Работа с аудио: озвучка персонажей, липсинк, фоновые звуки.

- Встроенный видеоредактор: базовый — редактирование через промпты.

- Цена: $8 в месяц за базовый тариф, который включает 700 токенов, «костылей» нет

Pika — нейросеть для генерации роликов с упором на визуальные эффекты. Главная фишка этого сервиса заключается в том, что алгоритмы умеют плавно переключаться между фотореализмом и мультипликацией.

Контентмейкеры положительно оценили версию 1.5, но в ходе разработки модели 2.5 разработчики провели масштабную работу над ошибками. Теперь Pika может похвастаться следующими преимуществами:

- разнообразие визуальных эффектов — ИИ моментально меняет одежду на персонажах, сжимает объекты, превращает их в другие и не только;

- скорость генерации — ролики генерируются за 20–40 секунд;

- гибкое управление камерой — можно регулировать скорость зума, ракурсы, уровень резкости и не только.

Есть у Pika весомый минус — чтобы озвучить персонажа, придется генерировать аудио отдельно.

Так как этот сервис заточен под визуальные эффекты, слегка отойдем от первичных требований к тестовому заданию — во второй сцене попросим ИИ превратить робота в чайник.

В первой сцене мы столкнулись с артефактом. Обратите внимание, как глобус приклеился к кисти робота.

Вторая сцена выдалась кринжовой — никакого столика в кафе, а в чайник превратилось только туловище робота.

Радует, что генерация заняла по 40 секунд на каждый ролик.

Сравнительная таблица нейросетей для видео

Чтобы подвести итог, мы составили таблицу, где сравнили 6 сервисов по основным параметрам.

| Название | Цена базового месячного тарифа | Стиль | Слабые места | Скорость генерации |

| Google Veo | $19,99 | Фотореализм | Непонимание русского языка, слабый липсинк | 1 минута |

| Kling AI | $6,99 | Фотореализм | Картонные персонажи, слабое понимание промпта | До 40 минут |

| Seedance | €17 | Фотореализм/мультипликация | Не обнаружено | 2 минуты |

| Wan | $5 | Фотореализм | Слабое понимание промпта, отсутствие липсинка | 2 минуты |

| Runway Gen | $9,9 | Фотореализм/мультипликация | Слабое понимание промпта, картонные персонажи | 5 минут |

| Pika | $8 | Мультипликация/визуальные эффекты | Картонные персонажи, слабое понимание промпта, нет автоматической генерации звуков | До 1 минуты |

Самые стабильные результаты показали Veo и Seedance — если править сцены по 3 раза не хочется, присмотритесь к этим нейросетям. Добавим, что сервис от Google можно использовать бесплатно, если включить хитрость и нафармить пачку аккаунтов. У остальных «участников» возникли разные проблемы: не исключено, что они исчезнут после обновлений.

Заключение

ИИ-сервисы сильно шагнули вперед, но универсальной нейросети для генерации любых роликов не существует. Если вы задумались о построении полноценного продакшена, придется комбинировать инструменты.

Не забывайте, что результат не всегда упирается в нейросеть. Если промпт бестолковый, на выходе навряд ли получится конфетка. Учитесь составлять запросы, тестируйте и выбирайте лучший вариант!

Вам была полезна эта статья?

2

0

Похожие статьи